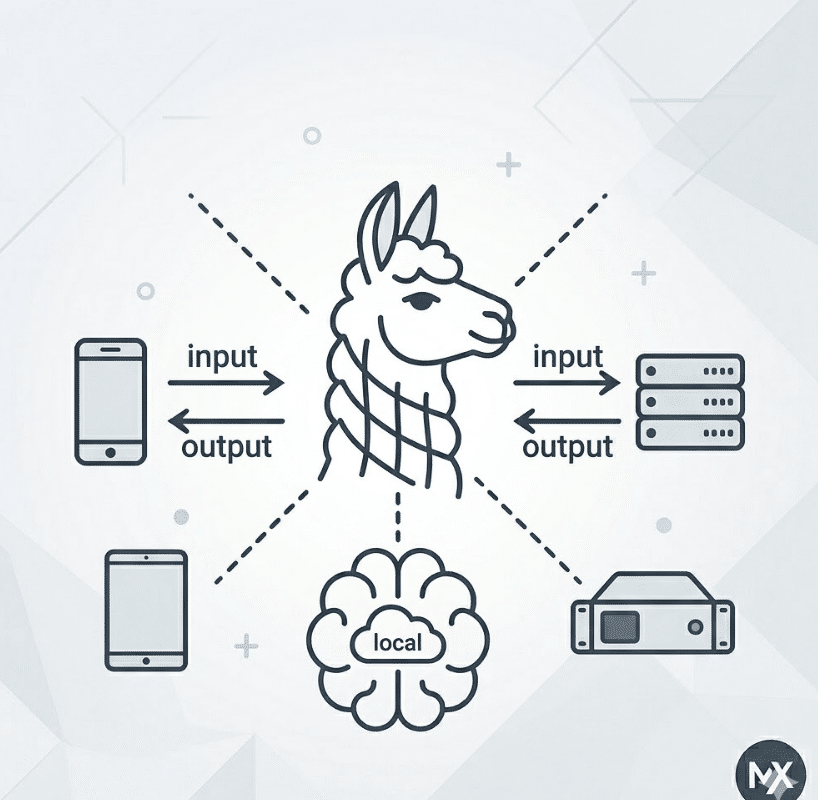

Avoir un LLM qui tourne sur ton propre serveur, sans envoyer tes questions à un tiers, c’est possible et plus simple qu’il n’y paraît. Ollama Docker gère l’exécution des modèles de langage en local, et Open WebUI fournit l’interface web. Sur le MS-01 avec ses ressources dédiées, les modèles 7B tournent sans problème pour une utilisation quotidienne.

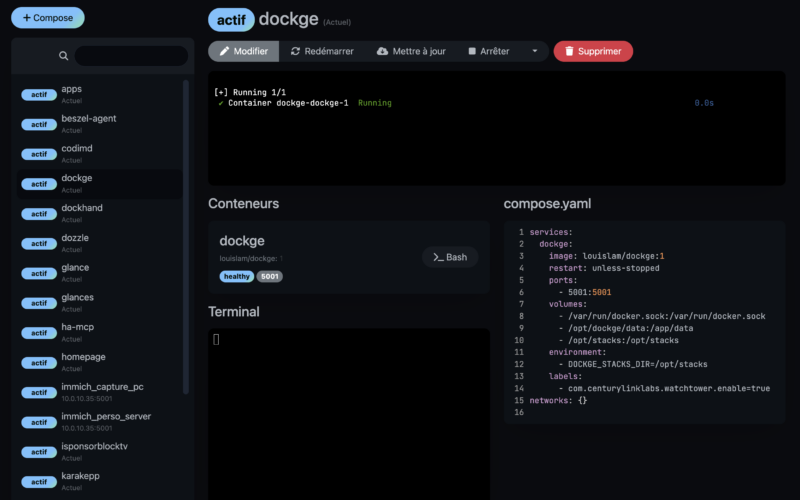

Installer Ollama Docker et Open WebUI

services:

ollama:

image: ollama/ollama:latest

container_name: ollama

restart: unless-stopped

ports:

- "11434:11434"

volumes:

- /opt/stacks/ollama/data:/root/.ollama

# Pour GPU NVIDIA : décommenter les lignes suivantes

# deploy:

# resources:

# reservations:

# devices:

# - capabilities: [gpu]

open-webui:

image: ghcr.io/open-webui/open-webui:main

container_name: open-webui

restart: unless-stopped

ports:

- "3030:8080"

volumes:

- /opt/stacks/open-webui/data:/app/backend/data

environment:

- OLLAMA_BASE_URL=http://ollama:11434

depends_on:

- ollama

Télécharger un modèle

Une fois Ollama Docker démarré, tu pulls les modèles depuis le terminal :

docker exec -it ollama ollama pull llama3.2

docker exec -it ollama ollama pull mistral

docker exec -it ollama ollama pull phi3.5

Les modèles 7B (Mistral, Llama 3.2 3B, Phi 3.5) sont suffisants pour un usage quotidien sans GPU. Ils nécessitent environ 4-8 Go de RAM selon la quantisation. Sur une machine avec 16 Go de RAM, tu peux faire tourner un modèle 7B en parallèle d’autres services sans problème notable.

Ce que j’utilise vraiment

Open WebUI supporte les conversations multi-tours, les fichiers en pièce jointe et les RAG (Retrieval Augmented Generation) sur tes propres documents. Je l’utilise principalement pour analyser des logs Proxmox, rédiger des scripts bash, et tester des prompts sans faire fuiter mes configs serveurs vers des services tiers.

La différence avec ChatGPT : tes données ne quittent jamais ton réseau. Pour de l’analyse de logs contenant des IPs internes, des configs serveur ou des données sensibles, c’est une vraie différence.

Pour aller plus loin

Ollama Docker tourne sur le nœud MS-01 de mon homelab — c’est le nœud avec le plus de RAM dédié aux workloads lourds. Documentation complète et liste des modèles disponibles sur ollama.com.

Pourquoi Ollama Docker m’est utile à distance

Ce que j’apprécie particulièrement : accéder à un LLM local depuis n’importe où via mon accès distant, sans dépendre d’un service tiers. Si je suis en déplacement et que j’ai besoin d’analyser un fichier de config ou de générer un script bash avec des données de mon infrastructure, Open WebUI est disponible. Le modèle que j’utilise principalement en ce moment : Qwen3, qui offre un excellent rapport qualité/ressources pour une utilisation quotidienne sans GPU dédié.

Expose Ollama uniquement sur le réseau interne (pas de port public) et utilise un reverse proxy avec authentification pour accéder à Open WebUI depuis l’extérieur. Les modèles LLM en local n’ont aucun intérêt si n’importe qui sur Internet peut les interroger. Traite ça comme n’importe quel service interne sensible.

👉 Pour aller plus loin : gérer ses containers avec Dockge, centraliser son homelab avec Glance et mon setup homelab 2026.