Mon homelab a bien évolué ces deux dernières années. Ce qui avait commencé par une simple curiosité est devenu une infrastructure complète qui fait tourner ma domotique, mon réseau, mes médias et mon monitoring. En 2026, chaque brique a trouvé sa place — pas sans quelques galères sérieuses en chemin.

Voici un tour complet de mon setup. J’explique chaque choix, les vraies difficultés rencontrées, et ce que je referais différemment si je recommençais de zéro.

L’architecture globale

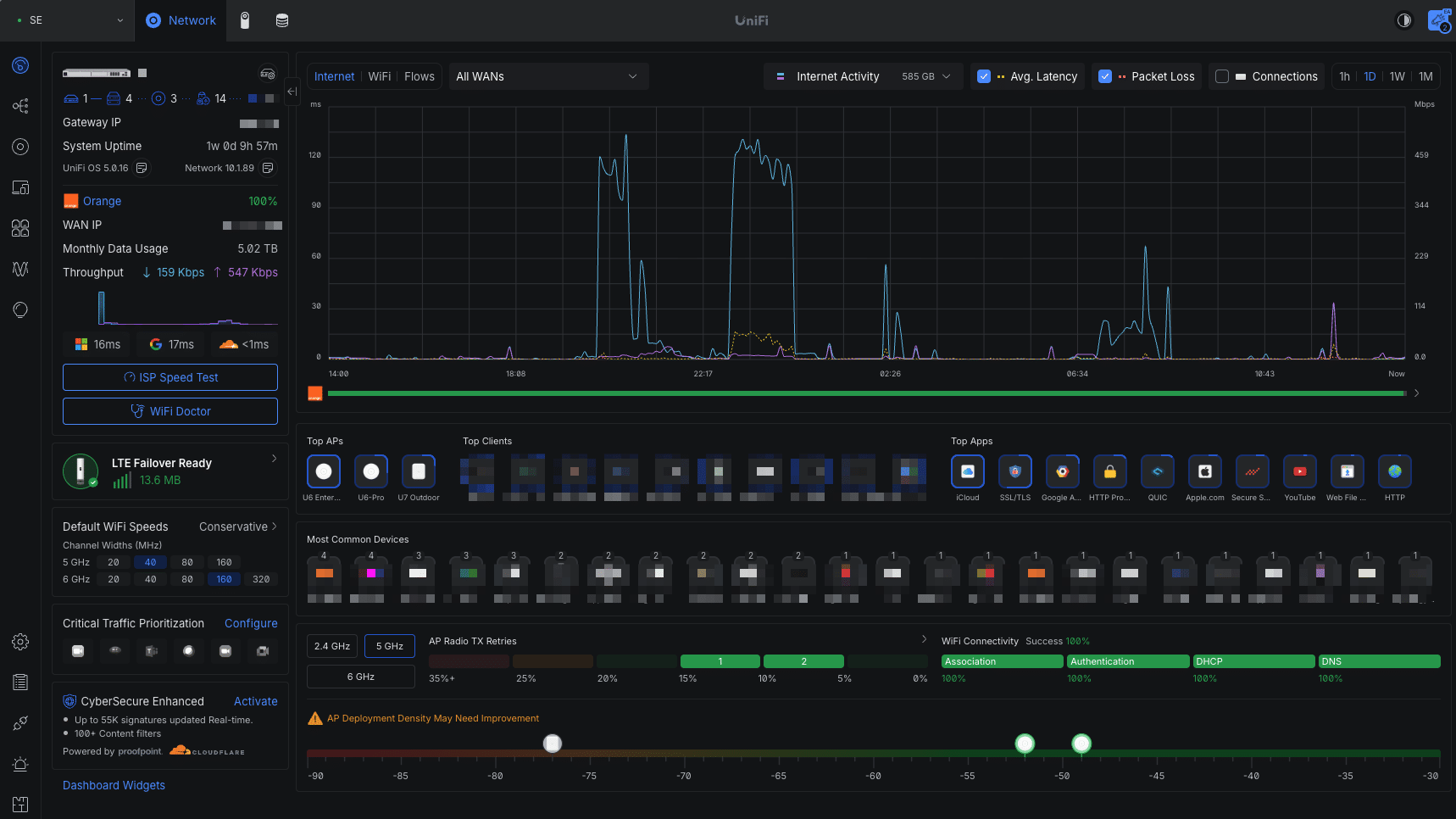

- Routeur/Firewall : UniFi Dream Machine SE

- Switch : UniFi Switch Pro 24 PoE

- Wi-Fi : UniFi U6 Pro

- Cluster Proxmox : 3 nœuds — 2 Intel NUC + 1 Minisforum MS-01

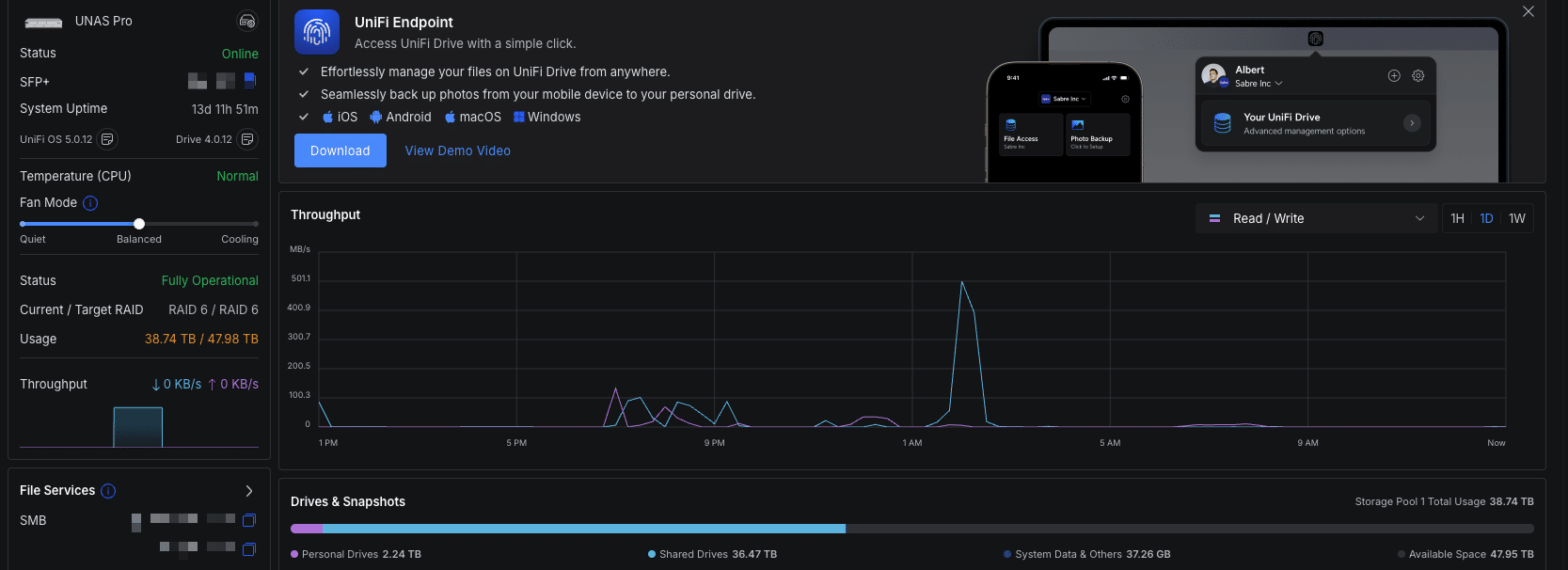

- Stockage principal : UniFi UNAS Pro (SFP+ 10GbE)

- Stockage legacy : Synology NAS (photos, archives, backup local)

- Backup off-site : disque dur externe hors site

- Domotique : Home Assistant OS (VM sur le nœud 1, pool ZFS (le système de fichiers qui ne perd jamais de données grâce à des checksums automatiques) (le système de fichiers qui ne perd jamais de données grâce à des checksums automatiques))

- Éclairage : Philips Hue (100+ lampes sur 3 ponts)

- Zigbee : Zigbee2MQTT en container Docker + Mosquitto

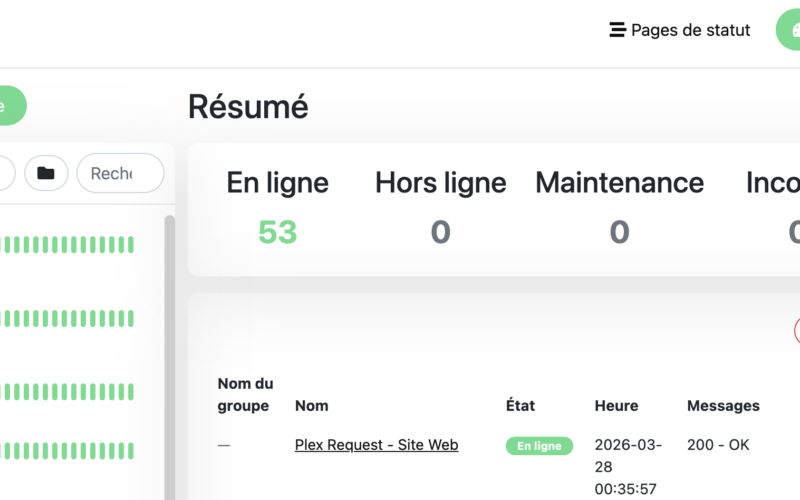

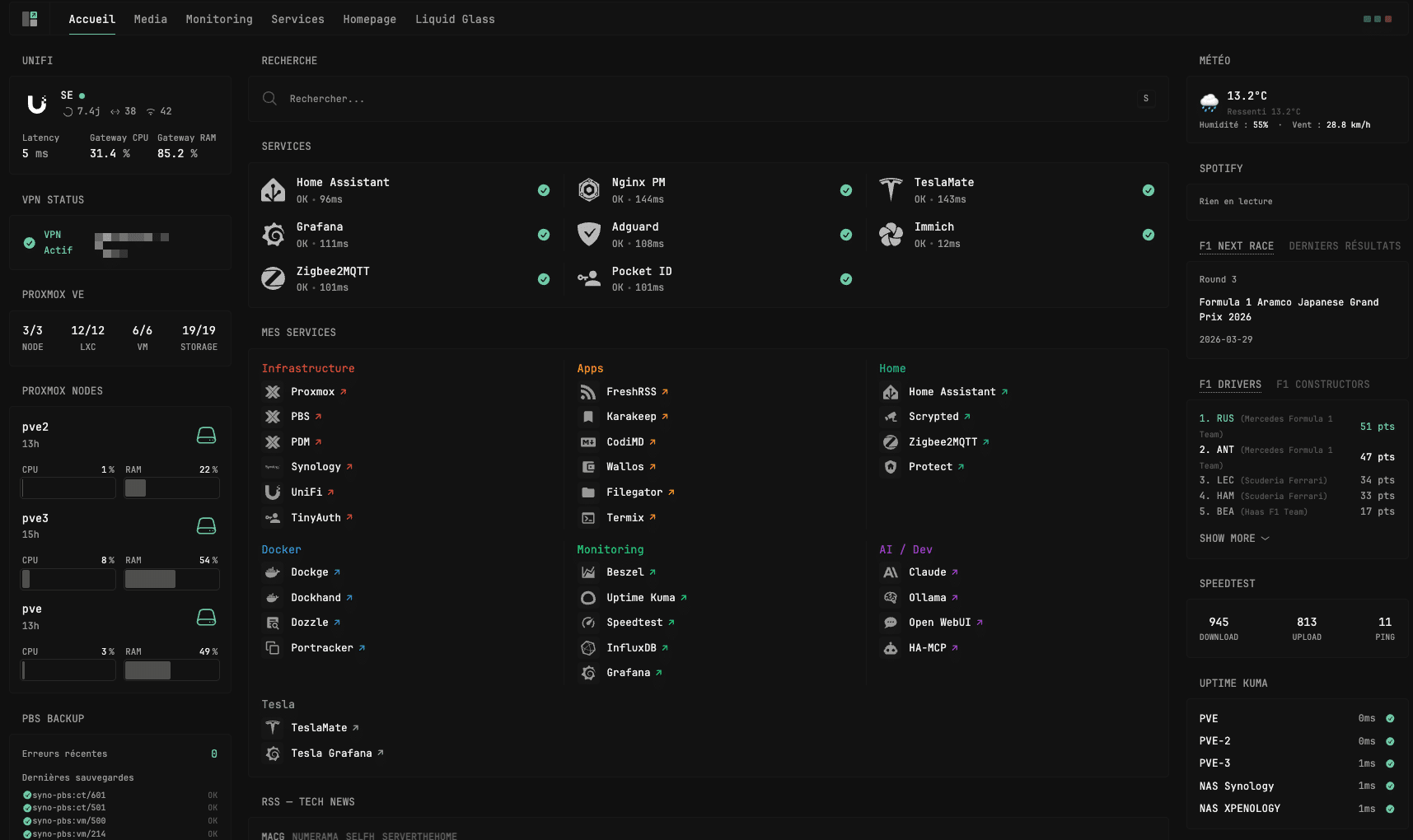

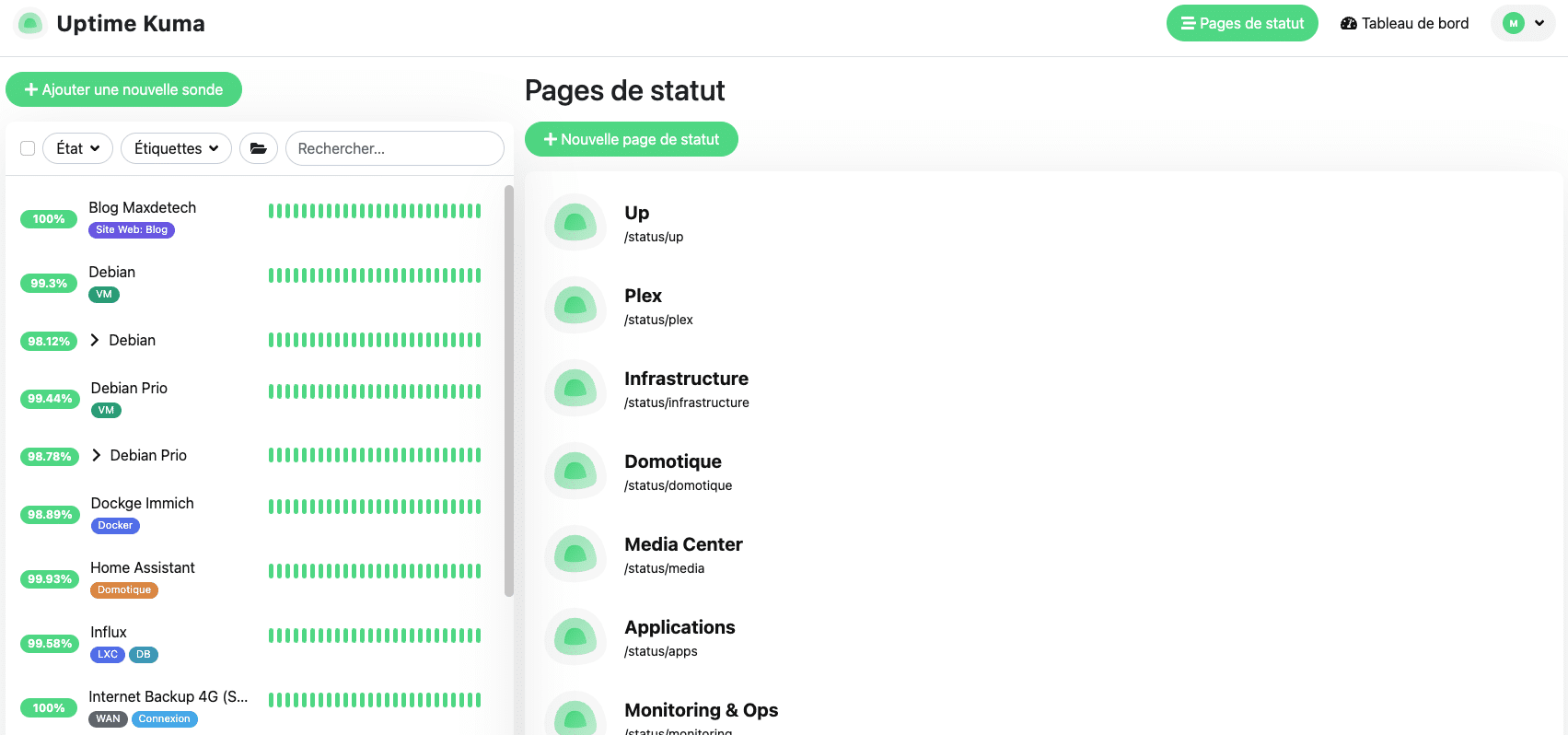

- Monitoring : Uptime Kuma + Glance Dashboard

- Containers Docker : gérés via Dockge sur les 3 nœuds

- Alimentation : 3 onduleurs — réseau, cluster, domotique (ponts Hue inclus)

Le réseau : tout UniFi

J’ai fait le choix du full UniFi il y a trois ans. La Dream Machine SE gère le routage, le firewall, les VLANs, l’IDS/IPS et le VPN WireGuard depuis une interface unique. Ce qui m’a le plus convaincu sur le long terme : la stabilité. Pas une panne réseau non planifiée en deux ans. Pour un homelab qui fait tourner la domotique de toute la maison, c’est ce qui compte.

Plusieurs VLANs en place : réseau principal, IoT (appareils domotiques isolés du reste), serveurs, invités. L’isolation du VLAN (réseau virtuel isolé — comme des appartements dans le même immeuble qui ne peuvent pas se voir) (réseau virtuel isolé — comme des appartements dans le même immeuble qui ne peuvent pas se voir) IoT était une priorité. Exemple concret : l’aspirateur robot a accès à Internet pour ses mises à jour, mais aucun accès au LAN. Même chose pour les ampoules, les prises connectées, tout ce qui n’a pas besoin de voir le reste du réseau.

Le NAS principal est un UniFi UNAS Pro. J’ai remplacé mon Synology DS923+ pour rester dans l’écosystème. Mais le Synology n’est pas parti — il tourne toujours en parallèle pour les photos de famille, les archives et le backup local. Les deux cohabitent : Synology en lecture/backup, UNAS Pro pour les données actives.

Côté backup, j’ai trois niveaux : données actives sur l’UNAS Pro, copie locale sur le Synology, et un disque dur externe hors site pour les données critiques. La règle 3-2-1, enfin respectée.

Tout l’infrastructure tourne sur trois onduleurs : un pour le réseau, un pour le cluster Proxmox, et un pour la domotique — ponts Hue inclus. Ce dernier point est important : en cas de coupure de courant, quand l’alimentation revient, les ponts Hue sont déjà actifs. Pas besoin d’attendre que tout redémarre avant de pouvoir gérer les lumières.

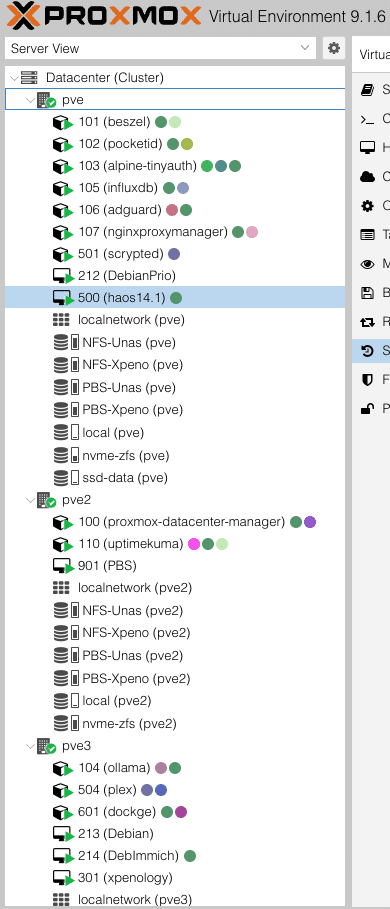

Les serveurs : cluster Proxmox 3 nœuds

C’est le cœur technique du setup — et la partie qui m’a donné le plus de fil à retordre.

- Nœud 1 — Intel NUC : nœud principal, VM Home Assistant + majorité des stacks Docker

- Nœud 2 — Intel NUC : services complémentaires, VMs de test

- Nœud 3 — Minisforum MS-01 : workloads lourds — Plex, Immich, stack media complète

Le MS-01 mérite un paragraphe à part. Ce qui m’a convaincu : le port SFP+ (10GbE natif vers le switch) et sa taille compacte. Il héberge les workloads qui ont besoin de bande passante. J’ai également une VM Xpenology dessus : un NVMe dédié monté via Xpenology et partagé sur le réseau en 10GbE pour les médias récents et certains backups intermédiaires.

La migration vers ZFS : la vraie galère

Je ne vais pas mentir : monter ce cluster m’a pris beaucoup plus de temps que prévu. La raison principale : j’ai dû migrer tout le stockage vers ZFS en cours de route.

Au départ, mes nœuds tournaient avec du stockage ext4 classique. Quand j’ai voulu activer la réplication ZFS entre nœuds (indispensable pour la haute dispo), j’ai réalisé que mes disques n’étaient pas en ZFS. Résultat : j’ai dû supprimer toutes mes VMs, convertir les pools en ZFS, et tout recréer depuis zéro. Une nuit et demie de travail.

(container Linux léger, comme une VM mais sans l'overhead — parfait pour les services simples)-liste.png)

Autre migration douloureuse : j’ai longtemps fait tourner mes nœuds sur Ubuntu avec interface graphique. La GUI prenait des ressources inutiles. J’ai finalement tout réinstallé sur Debian minimal sans interface. La différence en RAM disponible est significative.

Le réseau corosync : j’ai essayé de créer un lien Thunderbolt direct entre les machines. Ça n’a pas fonctionné de manière stable. J’ai opté pour un câble Ethernet dédié en 2.5G entre chaque hôte, hors du réseau principal. Simple, fiable. Et n’oublie pas de modifier /etc/hosts sur chaque nœud pour que les noms de cluster résolvent sur ce lien dédié, pas sur le réseau principal.

La consommation électrique

Un homelab 24/7, ça se paye sur la facture. Les NUC consomment peu au repos, le MS-01 un peu plus quand Plex transcode. Un point à améliorer : connecter les onduleurs en USB sur les nœuds pour déclencher un arrêt propre des VMs en cas de coupure longue.

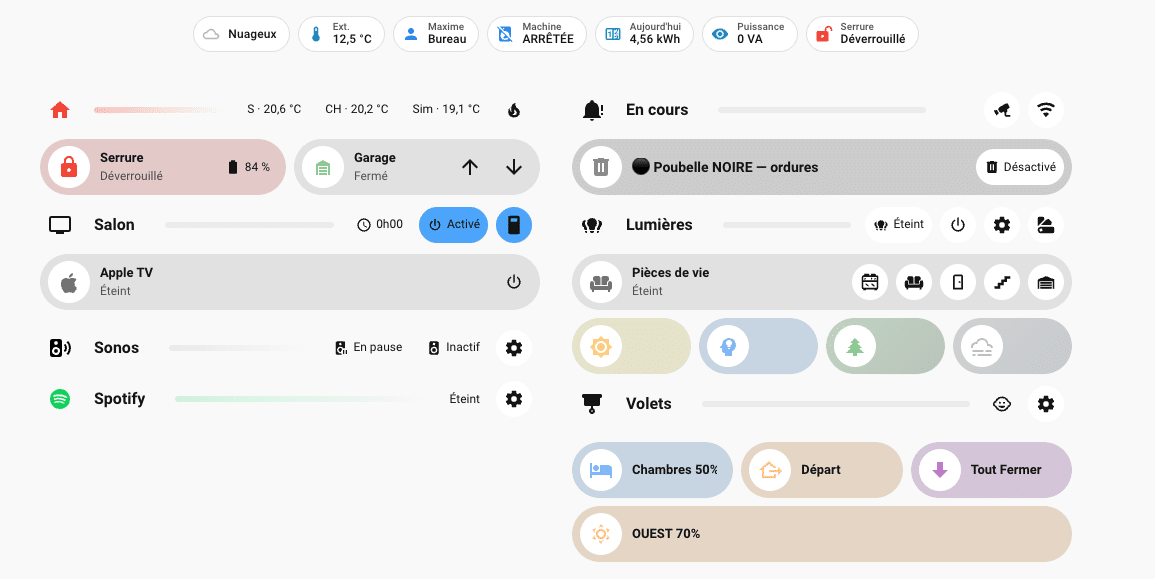

Home Assistant : le cerveau de la maison

Home Assistant gère tout : lumières, volets, scènes, automatisations. VM HAOS sur le nœud 1, répliquée sur les deux autres nœuds via ZFS. Guide d’installation complet ici.

100+ lampes Philips Hue sur 3 ponts, Zigbee2MQTT en Docker dédié — pas de passthrough USB dans la VM HA, c’est plus robuste lors des migrations. Tout est en YAML pur, les automatisations ont leur propre article.

Le monitoring : Glance + Uptime Kuma

Glance : dashboard de page d’accueil, vue instantanée de tous les services. Un fichier YAML, un container, minimaliste.

Uptime Kuma : 50+ monitors organisés par catégories. Si quelque chose tombe, Telegram en moins d’une minute, même en 4G. Setup complet ici.

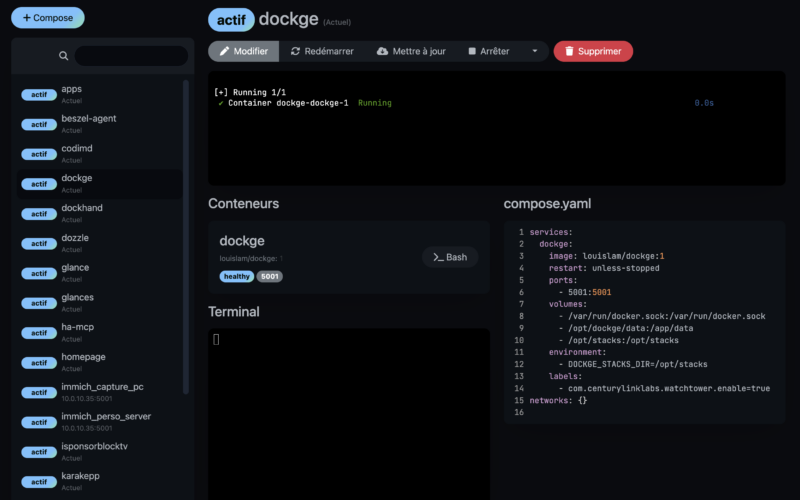

La gestion Docker : Dockge

30+ stacks sur 3 nœuds gérés via Dockge en mode multi-serveur. Les fichiers compose sont sur le disque, versionnés en Git. Pas de base de données, pas de conflit avec l’édition SSH.

Ce que je referais différemment

- ZFS dès le premier jour. Ne pas attendre d’en avoir besoin pour migrer. La migration depuis ext4 est pénible — on perd toutes ses VMs. Démarre en ZFS, point.

- Debian minimal dès le départ. Pas d’Ubuntu avec GUI sur un serveur Proxmox.

- Cluster dès le premier serveur. J’ai ajouté les nœuds un par un après coup. La migration des VMs existantes vers un cluster, c’est du stress inutile.

- Backup off-site le premier jour. Pas dans six mois, le premier jour.

- Firewall Proxmox activé dès l’installation. Restreindre l’accès à l’interface d’administration aux seules IPs du VLAN de management.

Conclusion

Mon homelab 2026, c’est deux ans d’itérations, de migrations forcées et de choix parfois revus. Le résultat tient la route : infrastructure qui tourne seule, supervision active, backup en trois niveaux.

La leçon principale : les bonnes pratiques ne s’improvisent pas après coup. ZFS, Debian minimal, cluster, backup off-site, firewall — tout ça s’intègre dix fois plus facilement sur une installation fraîche que sur une infrastructure existante.

Mets en place un audit automatique régulier sur tes nœuds Proxmox. Un script cron qui tourne chaque nuit et remonte les erreurs de logs système, l’espace disque restant sur chaque pool ZFS, l’utilisation RAM et le statut de la réplication. Je reçois un résumé Telegram chaque matin. Si quelque chose dérive — un pool ZFS qui se remplit, une réplication qui décroche depuis 3 jours — je le vois avant que ça devienne un problème.

Attention aussi aux logs cosmétiques : certains services écrivent des Mo/s pour rien — warnings sans conséquence, traces de debug oubliées en prod. Ça représente de la RAM, du CPU, et une usure disque progressive. Analyser ses logs régulièrement, ce n’est pas seulement traquer les erreurs critiques — c’est aussi identifier ce qui écrit en boucle inutilement.

👉 Pour aller plus loin : installer Home Assistant sur Proxmox, gérer ses containers avec Dockge, et monitorer son homelab avec Uptime Kuma.

Et maintenant ?

Ce setup tourne depuis plus d’un an sans interruption majeure. Chaque composant a sa raison d’être, et j’ai fait en sorte que chaque couche puisse tomber sans entraîner les autres.

Si tu pars de zéro, commence par un seul nœud Proxmox et un switch UniFi. Le reste vient naturellement quand tu identifies tes vrais besoins. Résiste à l’envie de tout installer d’un coup — un homelab qui tourne est mieux qu’un homelab parfait sur le papier.

Les prochains articles détaillent chaque brique : Proxmox VMs et LXC, AdGuard Home, Uptime Kuma. Par où tu veux commencer ?